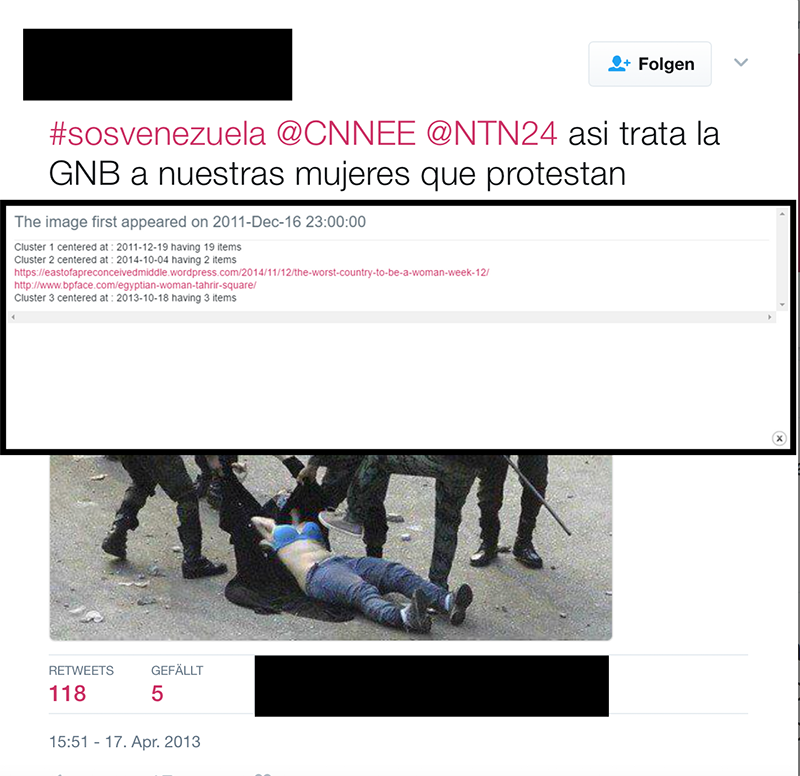

Am 21. Dezember 2011 erschien auf der Webseite npr.org ein Artikel über die Frühlingsrevolution in Ägypten. Dort ist ein Originalfoto abgebildet, das eine Frau zeigt, die von ägyptischen Soldaten getreten und weggezogen wird. Das gleiche Foto erschien über ein Jahr später, am 17. April 2013, als Tweet auf Twitter und soll Übergriffe der venezolanischen Nationalgarde bei friedlichen Protesten dokumentieren.

Die Verbreitung von Falschmeldungen, sogenannten „Fake News“, über das Internet ist ein hochaktuelles Problem. In sozialen Netzwerken kann sich Desinformation viral ausbreiten und so die öffentliche Meinung und das gesellschaftliche Stimmungsbild beeinflussen. Wissenschaftler am Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI) in Kaiserslautern arbeiten an Systemen die helfen Falschmeldungen anhand von Bildern zu erkennen.

Laut einer Analyse von Buzzfeed befassten sich 23 der 50 erfolgreichsten US-Nachrichten-Fälschungen des vergangenen Jahres mit politischen Themen. Über 10 Millionen von insgesamt 21,5 Millionen Reaktionen und Kommentare mit einem Bezug zur Politik in den USA sollen laut der Untersuchung einen Fake News-Bezug haben.

„Einhergehend mit der Fortentwicklung moderner Medien wird auch mit immer neuen Methoden und Werkzeugen versucht, diese zu manipulieren. Intelligente Technologien bieten wiederum vielfältige Ansätze, um dies zu erkennen oder entgegenzusteuern“, so DFKI-Forschungsbereichsleiter Professor Andreas Dengel. Sein Team im Forschungsbereich Smarte Daten & Wissensdienste beschäftigt sich unter anderem mit „Digital Forensics“ – neuesten Methoden zur Detektion, Analyse und Auswertung von kriminellen Inhalten in sehr großen Datenbeständen sowie Verfahren zum Schutz vor betrügerischen Tätigkeiten in digitalen Medien und Kanälen.

Gefälschte Bilder als Indiz

Fake News im Internet werden oftmals mit falschen, aus einem anderen Kontext stammenden, oder manipulierten Bildern versehen. Für die DFKI-Wissenschaftler in Kaiserslautern ist dies der Ansatz sie zu entlarven. Gefälschte Meldungen sind auch für den Menschen oft nicht direkt zu erkennen. Dennoch gibt es verschiedene Merkmale, beispielsweise falsche Bilder, die einem kritischen Betrachter auffallen können. „Unsere Methode kombiniert verschiedene Werkzeuge der Bilderkennung, um ein solches Verhalten zu simulieren“, so Dengel. Das prototypische System „NewsVerifier“ ist Erweiterung des Webbrowsers und für alle Quellen aus dem Internet nutzbar. Es läuft unauffällig im Hintergrund und schlägt verdächtige Bilder zur genaueren Überprüfung vor.

Kombination verschiedener Werkzeuge zu KI-System

„Die Funktionsweise des Systems beruht auf der Annahme, dass das Bildmaterial bereits zu einem früheren Zeitpunkt in einem anderen Zusammenhang publiziert wurde“, erklärt die Entwicklerin des Prototyps Sarah Elkasrawi. „Mit einer invertierten Bildersuche werden zunächst die ähnlichsten Fotos gesucht und deren Zeitstempel überprüft. Anhand der Übereinstimmungen und dem verknüpften Datum lässt sich feststellen, ob das Bild eventuell von einem früheren Ereignis stammt“, führt die DFKI-Forscherin weiter aus. Darüber hinaus verfügt NewsVerifier über einen am DFKI entwickelten speziellen Bildidentifikationsalgorithmus. Dieser erkennt mit sehr hoher Wahrscheinlichkeit ob Bilder manipuliert wurden. Dazu untersucht er inhaltliche Veränderungen zu ähnlichen Fotos. Eine weitere Funktion des Systems betrachtet den Text der Webseiten mit dem gefundenen Bildmaterial und filtert die wichtigsten Begriffe der Seite. Mit diesem „Clustering“ genannten Prozess erhält der Benutzer einen schnellen Überblick über den Inhalt der Quelle und kann damit den Zusammenhang zwischen Bild und Text prüfen.

Zur Zeit arbeiten die Forscher an der Integration einer Personenerkennung, die automatisch erkennt, ob auf einem Foto auch tatsächlich die vorgegebene Person abgebildet ist oder diese als jemand anderes ausgegeben wird. Fortschritte erhoffen sich die Wissenschaftler zudem aus dem Einsatz von Deep Learning-Technologien, durch die das System Bildmanipulationen zukünftig noch besser erkennen soll.

Mehr Infos hier.

Quelle: idw/DFKI

04/24/2017